Google aplica el algoritmo BERT a las clasificaciones de búsqueda, lo que afecta a 1 de cada 10 consultas

- 25 octubre, 2019

- Analítica web, Diseño web, Ecommerce, Marketing de contenidos, SEO, SEO local

Google está implementando lo que dice que es el mayor paso adelante para la búsqueda en los últimos 5 años, y uno de los mayores pasos adelante en la historia de la búsqueda.

Google está utilizando una nueva tecnología que introdujo el año pasado, llamada BERT, para comprender las consultas de búsqueda.

BERT significa representaciones de codificador bidireccionales de transformadores. Los transformadores se refieren a modelos que procesan palabras en relación con todas las demás palabras en una oración.

Eso significa que los modelos BERT pueden interpretar el significado apropiado de una palabra al observar las palabras que vienen antes y después. Esto conducirá a una mejor comprensión de las consultas, en comparación con el procesamiento de las palabras una por una en orden.

¿Qué significa esto para los SEO y los propietarios de sitios?

La utilización de modelos BERT por parte de Google para comprender las consultas afectará tanto a las clasificaciones de búsqueda como a los fragmentos destacados o snippets. Sin embargo, BERT no se utilizará para el 100% de las búsquedas.

Por ahora, BERT se utilizará en 1 de cada 10 búsquedas en los EE. UU, en inglés. Google dice que BERT es tan complejo que supera los límites del hardware de Google, lo que probablemente sea la razón por la que solo se usa en una cantidad limitada de búsquedas.

Los usuarios de búsqueda de Google en los EE. UU. deberían comenzar a utilizar más información útil en las búsquedas:

«Particularmente para consultas más largas y más conversacionales, o búsquedas en las que las preposiciones como «para»y «a» son muy importantes para el significado, Search podrá comprender el contexto de las palabras en su consulta. Puedes buscar de una manera que te parezca más natural».

Para los fragmentos destacados, Google está utilizando un modelo BERT para mejorar los resultados en las dos docenas de países donde hay fragmentos disponibles.

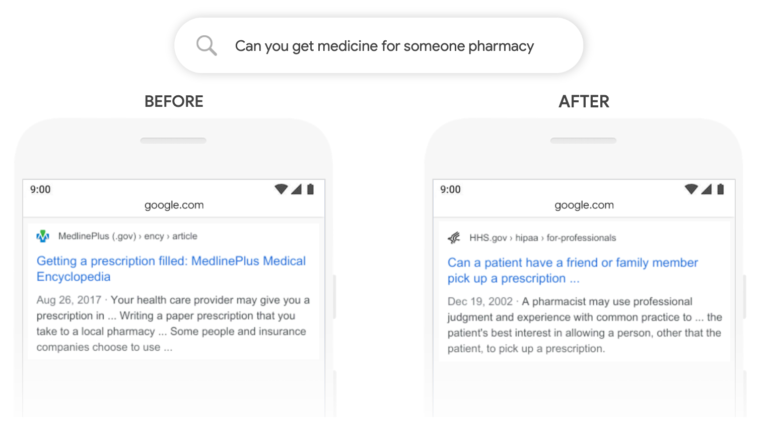

Google dice que BERT pasó por pruebas rigurosas para garantizar que los cambios sean realmente más útiles para los usuarios. Puede ver algunos ejemplos de antes y después en la siguiente sección.

Ejemplos de BERT en acción

En las pruebas, Google descubrió que BERT ayudó a sus algoritmos a comprender mejor los matices de las consultas y a comprender las conexiones entre palabras, cosa que antes no podía.

Aquí hay una búsqueda de «2019 brazil traveler to usa need a visa». Puede ver cómo BERT ayudó a Google a comprender que la consulta es sobre un brasileño que viaja a Estados Unidos, y no al revés.

Aquí hay otro ejemplo usando la consulta «do estheticians stand a lot at work». Anteriormente, Google interpretaba las palabras «stand» y «stand-alone» en el sentido de lo mismo, lo que conduce a resultados de búsqueda irrelevantes.

Usando BERT, Google puede interpretar mejor cómo se usa la palabra «stand» y comprender que la consulta está relacionada con las demandas físicas de ser un esteticista.

Aquí hay algunos ejemplos más antes / después de consultas con y sin BERT.

Una cosa a tener en cuenta sobre estos ejemplos es que fueron de las evaluaciones de Google, y podrían no reflejar al 100% lo que se muestra en vivo en los resultados de búsqueda. Estos ejemplos simplemente tienen la intención de ilustrar los tipos de desafíos de comprensión del idioma con los que BERT ayuda, pero, por supuesto, hay muchas otras consultas en las que BERT tendrá un impacto.

Mirando hacia el futuro

Con este cambio, Google tiene como objetivo mejorar la comprensión de las consultas, entregar resultados más relevantes y acostumbrar a los usuarios a ingresar consultas de una manera más natural.

Google no dijo en qué medida este cambio afectará a las clasificaciones de búsqueda. Dado que BERT solo se usa en el 10% de las consultas en inglés en los EE. UU., el impacto debería ser mínimo en comparación con una actualización de algoritmo a gran escala.

Comprender el lenguaje es un desafío continuo, y Google admite que, incluso con BERT, puede que no todo salga bien. Aunque la compañía se compromete a mejorar en la interpretación del significado de las consultas.

Acerca de nosotros y este blog

Somos una agencia de marketing digital con más de 20 años de experiencia ofreciendo soluciones estratégicas efectivas para crear y promover tu negocio online.

Solicita un informe gratuito

Ofrecemos servicios profesionales de diseño web, programación de aplicaciones móviles y marketing online que ayudan a los negocios online a aumentar drásticamente sus ingresos.

Suscríbete a nuestra newsletter!

Categorías

- Agencia (4)

- Analítica web (11)

- Apps móviles (9)

- Big data (6)

- Consultoría digital (15)

- CRO marketing (3)

- Diseño web (16)

- Ecommerce (13)

- Email marketing (4)

- Marketing de contenidos (11)

- Marketing de influencers (3)

- Marketing online (6)

- PPC marketing (8)

- Redes sociales (15)

- SEO (7)

- SEO local (5)

- Servicios cloud (6)

- Sin categoría (2)

- UX (7)

Entradas recientes

- ¿Qué es la optimización de la tasa de conversión o CRO? 1 agosto, 2024

- 8 razones por las que su equipo de marketing necesita una herramienta de CRM 29 julio, 2024

- Por qué los chatbots y el texto están reemplazando a las llamadas telefónicas 22 julio, 2024

- 7 maneras en que la automatización de marketing agilizará sus procesos comerciales 20 julio, 2024

- Empieza el proceso de digitalización de tu empresa sin preocuparte por las ofertas de internet 19 julio, 2024